המעבר מחיפוש מבוסס מילים לחיפוש מבוסס שיחה והקשר

במשך שני עשורים הורגלנו לכתוב תוכן שמתמקד במילות מפתח. המשתמש היה מקליד ביטוי קצר, ומנוע החיפוש היה סורק את הרשת כדי למצוא את העמודים שמכילים את הביטוי הזה בצורה האופטימלית ביותר. אך העידן הזה הגיע לקיצו. מנועי החיפוש המודרניים המבוססים על בינה מלאכותית אינם מחפשים עוד התאמה של תווים או מילים. הם מבצעים תהליך של קריאת הקשר, ניתוח סמנטי של המשפט והבנה מעמיקה של הפסיכולוגיה מאחורי הפרומפט.

כאשר גולש כותב פרומפט ארוך, הוא בעצם חושף מספר שכבות של כוונות. הוא לא רק רוצה לדעת עובדה מסוימת, אלא לרוב הוא מבקש פתרון לבעיה ספציפית, השוואה בין חלופות או סיכום של מידע מורכב. כדי שאתר אינטרנט יהפוך למקור מידע רלוונטי עבור האלגוריתמים החדשים, עליו להיות בנוי בצורה שמשקפת הבנה של אותן שכבות נסתרות. כאן נכנס לתמונה המושג של חיפוש סמנטי, אשר מתבסס על הבנת המשמעות הרעיונית של המילים ולא רק על צורתן הכתובה.

איך מודלים של בינה מלאכותית מחלצים את צורך המשתמש

כדי לכתוב תוכן שלוחץ על הכפתורים הנכונים של מנועי החיפוש החדשים, חובה עלינו להבין את המנגנון הטכני שבאמצעותו הם פועלים. מודלים מתקדמים משתמשים בטכנולוגיה הנקראת עיבוד שפה טבעית בשילוב עם מנגנוני תשומת לב. כאשר המערכת קולטת פרומפט, היא מפרקת אותו ליחידות קטנות, בוחנת את הקשר בין כל יחידה לאחרת, ומייצרת וקטור מתמטי שמייצג את המשמעות הכוללת של הבקשה.

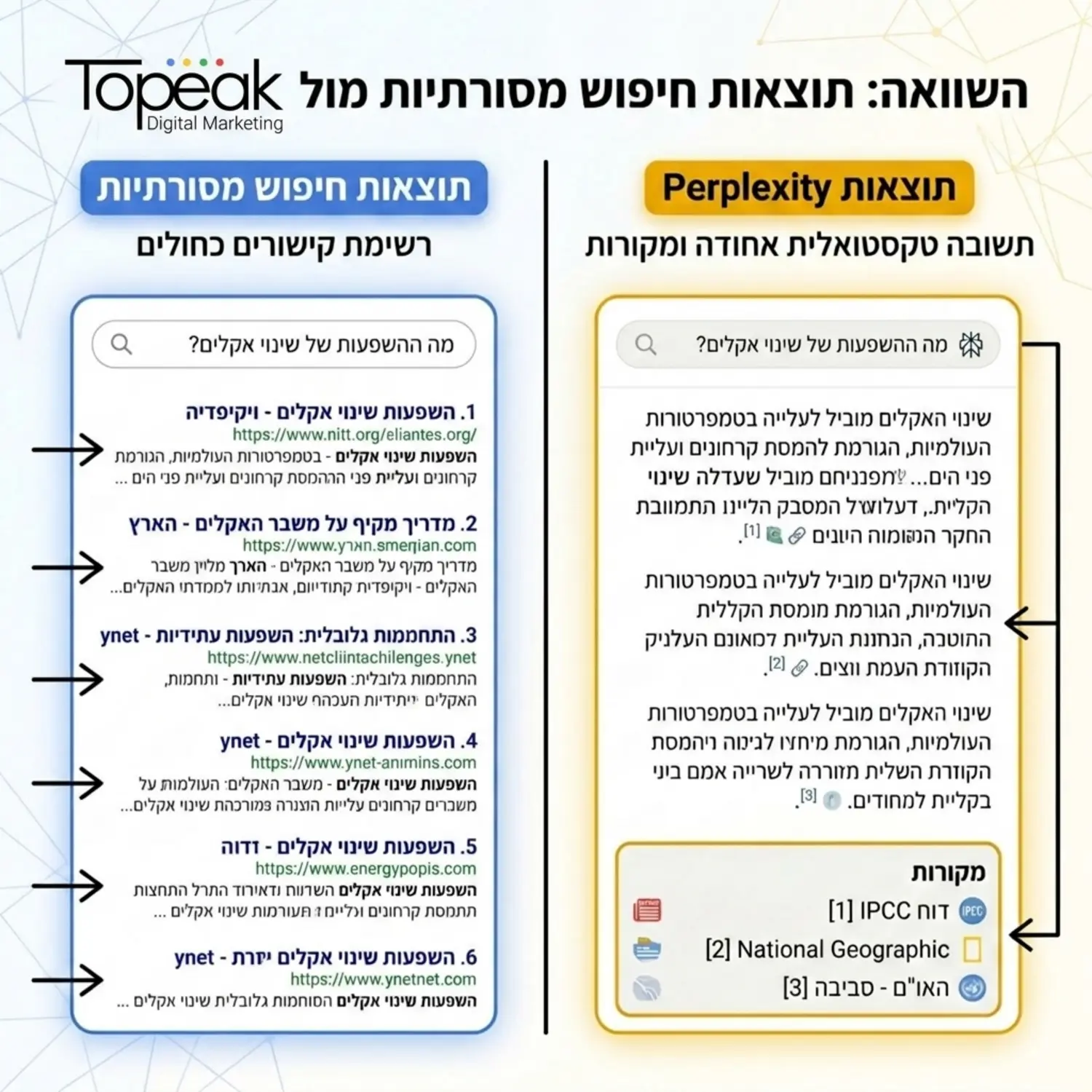

לאחר ניתוח הבקשה המערכת יוצאת לתהליך אחזור מידע. בניגוד לעבר שבו חיפשנו רק כותרות מתאימות, היום המערכת מחפשת פסקאות ממוקדות בתוך מאמרים ארוכים שעונות בדיוק על השאלה שנשאלה. תהליך זה נקרא יצירת תוכן מועשר באחזור, והוא המפתח להבנת האופן שבו מנוע כמו פרפלקסיטי בוחר את המקורות שלו. המנוע סורק את הרשת בזמן אמת, שולף את העובדות הרלוונטיות ביותר ממקורות סמכותיים, ומרכיב מהם תשובה אחידה עבור המשתמש.

שלושת שלבי הפענוח של אלגוריתם מבוסס AI

- זיהוי ישויות: המערכת מזהה מי הם האנשים, המקומות, המושגים או המוצרים שהמשתמש שואל עליהם.

- ניתוח כוונת פעולה: המערכת מנסה להבין האם המשתמש רוצה לקנות משהו, ללמוד משהו, להשוות או לקבל השראה.

- בדיקת אילוצים: חילוץ תנאים ספציפיים מתוך הפרומפט, למשל בקשה לתשובה קצרה, דרישה לנתונים עדכניים מהשנה האחרונה או התמקדות באזור גיאוגרפי מסוים.

הסודות של מנוע החיפוש פרפלקסיטי

אם אנחנו רוצים שהתוכן שלנו יצוטט במנועי חיפוש מבוססי תשובות כמו פרפלקסיטי, עלינו לזנוח חלק מההרגלים הישנים שלנו וליצור אסטרטגיה חדשה של קידום אתרים בגוגל ובמנועי החיפוש המקבילים. פרפלקסיטי אינו מתרשם מטקסטים ארוכים ומנופחים שאין בהם מהות אמיתית. הוא מחפש צפיפות מידע, אמינות ותשובות ברורות.

כאשר אלגוריתם של מנוע שיחה מנתח את האתר שלכם הוא מעניק משקל עצום לפרמטרים הבאים

- מבנה נתונים והיררכיה: שימוש נכון בכותרות משנה, רשימות וטבלאות מאפשר לבוטים לסרוק ולשלוף את המידע בקלות רבה יותר.

- תשובות ישירות: מתן תשובה ברורה ומדויקת כבר בתחילת הפסקה, ולאחריה פירוט והסבר מעמיק. אין מקום להקדמות ארוכות ומתישות.

- גיבוי עובדתי: שילוב של סטטיסטיקות, מחקרים וציטוטים של מומחים מגביר את הסיכוי שהבינה המלאכותית תסמוך על התוכן שלכם כמקור אמין.

- הימנעות מתוכן שיווקי אגרסיבי: מודלים של בינה מלאכותית מאומנים לזהות ולסנן תוכן שיווקי מוגזם. הם מחפשים ערך אינפורמטיבי טהור.

איך לכתוב תוכן שמרצה את הבוטים וגם את בני האדם

האתגר הגדול ביותר כיום הוא למצוא את נקודת האיזון המושלמת. מצד אחד אנחנו צריכים לכתוב עבור רובוטים חכמים שמחפשים מבנה נתונים מושלם, ומצד שני אנחנו עדיין כותבים עבור בני אדם שצריכים להרגיש חיבור לטקסט ולהשתכנע ממנו. שירות מקצועי של כתיבת תוכן לאתרים חייב להתייחס לשני הקהלים הללו במקביל.

כדי לייצר תוכן מנצח מומלץ לאמץ את מודל הפירמידה ההפוכה שמותאם לעידן החדש. התחילו עם התשובה המוחלטת והמדויקת ביותר לשאילתת המשתמש. בפסקה השנייה ספקו את ההקשר והרקע המקצועי. בפסקאות הבאות צללו לפרטים הקטנים, הביאו דוגמאות מוחשיות, הציגו נתונים מספריים ושלבו טבלאות השוואה. גישה זו מבטיחה שהמודל יוכל לשלוף את התשובה המהירה עבור תקציר התוצאות שלו, בעוד שגולש אנושי שיבחר להעמיק יוכל לקרוא את המאמר המלא ולקבל ערך עצום.

הכוח של שאלות ותשובות בתוך התוכן

אחת הדרכים היעילות ביותר לאותת למנועי החיפוש שהתוכן שלכם רלוונטי לפרומפטים שונים היא שילוב של מקטע שאלות ותשובות מקיף. מכיוון שמשתמשים רבים מקלידים שאלות מלאות כמקשה אחת, אם האתר שלכם מכיל בדיוק את אותה השאלה בכותרת ואחריה תשובה תמציתית, אתם מקפיצים את הסיכויים שלכם להופיע כמקור הציטוט הראשי.

הקשר בין תשתית טכנולוגית לדירוג במנועי בינה מלאכותית

לא משנה כמה התוכן שלכם יהיה עשיר ואיכותי, אם התשתית של האתר לקויה המודלים המתקדמים יתקשו לסרוק אותו. כאן נכנסת החשיבות של בחירת חברה לבניית אתרים שתדע להכין את הקרקע מבחינה טכנית. אתר שנטען במהירות, מגיש קוד נקי ותקין, ועושה שימוש נרחב בסכמות ונתונים מובנים מקבל עדיפות מובהקת בסריקה.

מנועי הבינה המלאכותית עובדים תחת מגבלות של כוח מחשוב. הם מעדיפים לשאוב מידע מאתרים שמגישים להם את הנתונים על מגש של כסף. הקפדה על תגיות מטא מדויקות, תיאורי תמונות מפורטים ויצירת מפת אתר לוגית הם לא נחלת העבר, אלא הבסיס ההכרחי שעליו נבנית האופטימיזציה לדור הבא של החיפוש.

יצירת אשכולות תוכן מבוססי הקשר

טכניקה מתקדמת נוספת לפענוח כוונת המשתמש היא מעבר מחשיבה על עמודים בודדים לחשיבה על אשכולות תוכן. אלגוריתמים של שפה טבעית מבינים שנושא מורכב אינו יכול להיות מכוסה בעמוד אחד בלבד. הם מחפשים סמכות נושאית רחבה.

בנו עמוד פילר מרכזי שעונה על נושא הליבה, וקשרו ממנו לעמודי משנה שכל אחד מהם עונה על פרומפט ספציפי וצר יותר שאותו משתמש עשוי לשאול בשלב הבא של המחקר שלו. בצורה זו אתם בונים רשת סמנטית של מידע שמדריכה את המנוע ומראה לו שאתם מומחים אמיתיים בתחום שלכם בעלי ידע מקיף ומעמיק.

| מאפיין החיפוש | מנועי חיפוש מסורתיים | מנועי חיפוש מבוססי AI |

|---|---|---|

| מבנה השאילתה | מילות מפתח קצרות ובודדות | משפטים ארוכים, שאלות ופרומפטים |

| מטרת האלגוריתם | התאמת מילים והצגת רשימת קישורים | הבנת הקשר, חילוץ עובדות ויצירת תשובה |

| פרמטרים קריטיים לדירוג | כמות קישורים נכנסים וצפיפות מילים | סמכות מקצועית, צפיפות עובדתית ומקורות אמינים |

| אופן הצגת התוכן הנדרש | מאמרים ארוכים עם חזרות על ביטויים | תשובות ישירות, טבלאות, נתונים מובנים ללא מלל מיותר |

לסיכום החלק הטכני והתוכני כאחד ההבנה של מנגנוני הבינה המלאכותית דורשת מאיתנו להיות מדויקים מתמיד. כל משפט צריך לשרת מטרה. כל פסקה צריכה לקדם את ההבנה של הקורא או המכונה. זהו עידן שבו האיכות והעומק של המידע מנצחים את הכמות ואת המניפולציות הטכניות של העבר.