מהו תקציב זחילה ומדוע הוא קריטי ל-SEO?

במונחים פשוטים, תקציב זחילה הוא תשומת הלב שגוגל מוכן להקדיש לאתר שלכם. הבוט של גוגל (Googlebot) משוטט ברחבי הרשת במטרה למצוא תוכן חדש או מעודכן ולהוסיף אותו לאינדקס. עם זאת, האינטרנט עצום, והמשאבים של גוגל, עד כמה שהם אדירים, עדיין מוגבלים. לכן, האלגוריתם מחליט כמה עמודים לסרוק בכל אתר ובאיזו תדירות.

כאשר אנו מדברים על קידום אורגני לאתרים מורכבים כמו אתרי מסחר אלקטרוני (eCommerce), אתרי חדשות או פורטלים גדולים, ניהול התקציב הזה הופך להיות קריטי. אם גוגל “מבזבז” את התקציב שלו על עמודים לא רלוונטיים, עמודי שגיאה או פרמטרים של סינון מוצרים, הוא עלול לא להגיע לעמודים החשובים שמייצרים עבורכם כסף.

שני המרכיבים של תקציב הזחילה

על פי המידע הרשמי של גוגל (Google Search Central), התקציב נקבע על ידי שילוב של שני פקטורים:

- מגבלת קצב הזחילה (Crawl Rate Limit): גוגל לא רוצה להפיל את האתר שלכם. הבוט מזהה כמה בקשות השרת שלכם יכול להכיל מבלי להאט את חוויית המשתמש. אם השרת מגיב לאט או מחזיר שגיאות, גוגל יוריד את קצב הסריקה.

- דרישת הזחילה (Crawl Demand): עד כמה גוגל רוצה לסרוק את האתר? זה תלוי בפופולריות של העמודים (קישורים נכנסים) וברעננות התוכן.

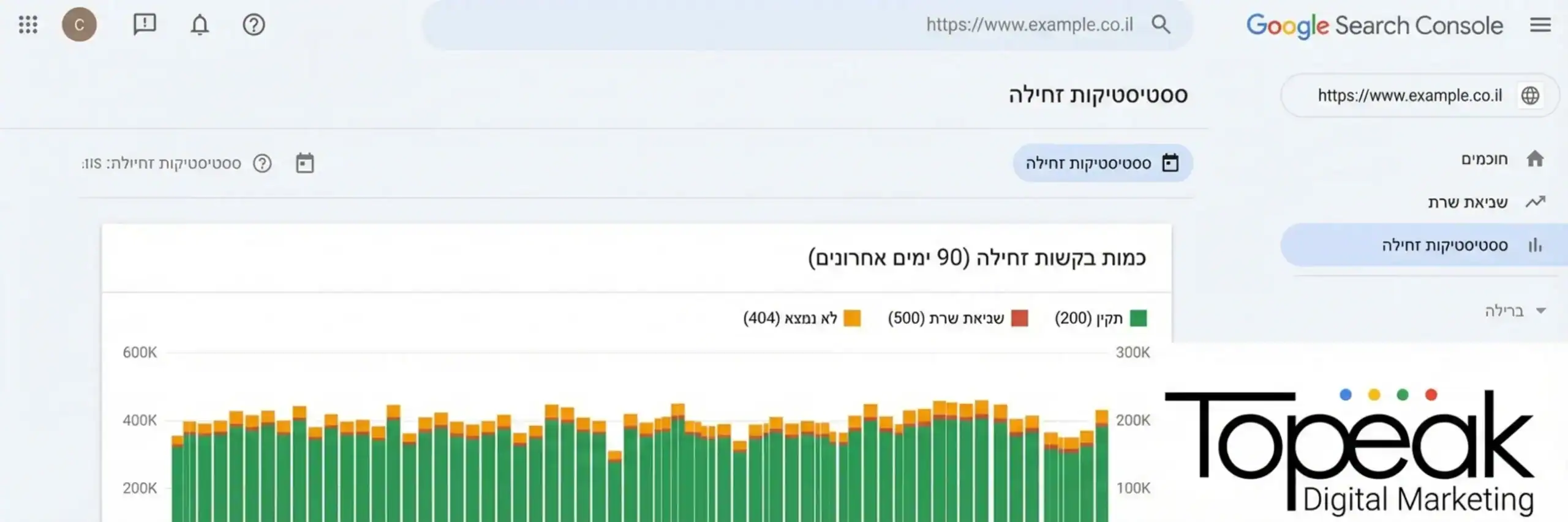

כיצד לזהות בעיות בתקציב זחילה?

לפני שרצים לבצע שינויים, צריך להבין את המצב הקיים. הכלי הטוב ביותר והנגיש ביותר לכך הוא Google Search Console. תחת הקטגוריה “הגדרות” (Settings), תמצאו את דוח “סטטיסטיקות זחילה” (Crawl Stats).

בדוח זה עליכם לחפש:

- ירידה פתאומית בכמות הבקשות היומית.

- עלייה בזמן התגובה הממוצע של השרת (זהו נתון קריטי).

- אחוז גבוה של שגיאות סריקה (404, 500).

נתון מדאיג נוסף הוא אם אתם מעלים תכנים חדשים והם לא מתאנדקסים במשך ימים או שבועות. זהו סימן מובהק לכך שגוגל לא מגיע אליהם בזמן.

אסטרטגיות למיקסום תקציב הזחילה

ניהול נכון של תקציב זחילה דורש עבודה טכנית מדוייקת. הנה הפעולות החשובות ביותר שצריך לבצע:

1. שיפור מהירות האתר וביצועי שרת

קיים מתאם ישיר בין מהירות השרת לבין כמות העמודים שגוגל סורק. ככל שהאתר מגיב מהר יותר, כך הבוט יכול לסרוק יותר עמודים באותו פרק זמן נתון. עליכם לוודא שהשרת שלכם חזק מספיק כדי להתמודד עם עומסים, להשתמש ב-CDN (רשת הפצת תוכן) ולבצע אופטימיזציה לקוד ולתמונות. בתהליך של בניית אתרים מודרניים, נושא המהירות חייב להילקח בחשבון כבר בשלב התכנון הראשוני ולא כטלאי מאוחר.

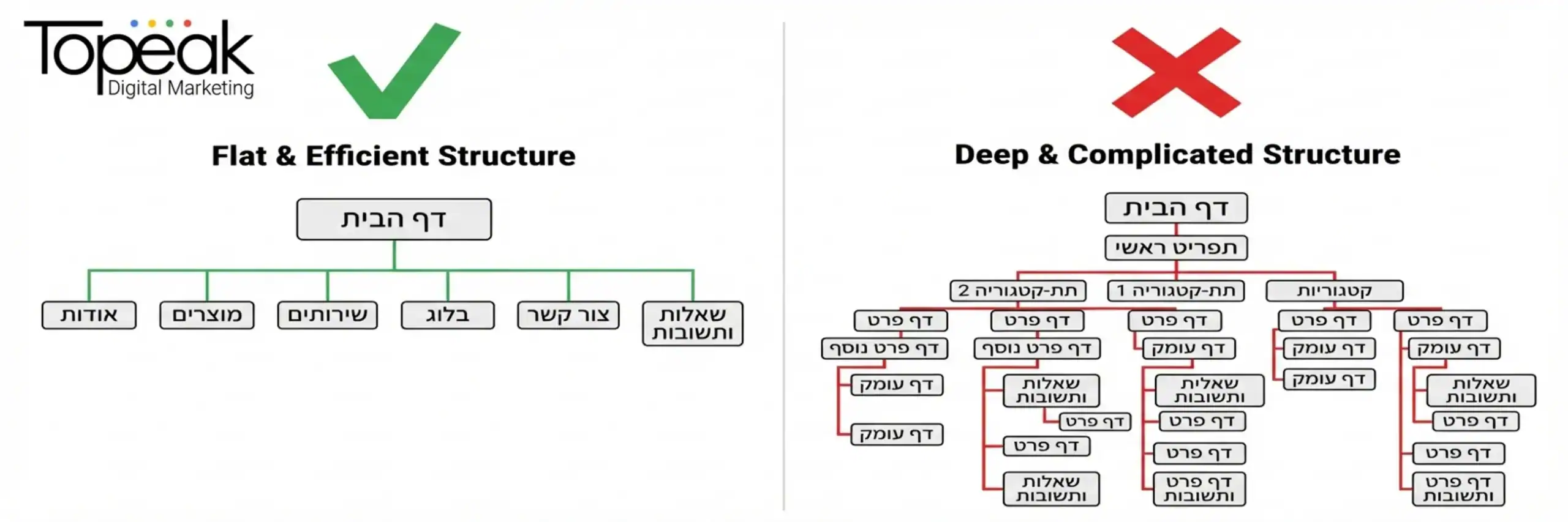

2. מבנה קישורים פנימיים שטוח

גוגל מגלה עמודים חדשים בעיקר דרך קישורים. אם העמודים החשובים שלכם קבורים עמוק בהיררכיה (למשל: דף הבית > קטגוריה > תת-קטגוריה > ארכיון > שנה > דף מוצר), הסיכוי שהבוט יגיע אליהם יורד.

השתמשו במבנה “שטוח” יותר, וודאו שכל עמוד חשוב נמצא במרחק של לא יותר מ-3 קליקים מדף הבית. השתמשו בקישורים פנימיים חכמים, כמו “מוצרים קשורים” או “פוסטים פופולריים”, כדי להזרים כוח לעמודים פנימיים. בעת עבודה עם כלי לקידום אתרים כמו Screaming Frog, ניתן לראות בבירור את עומק הזחילה (Crawl Depth) ולתקן בהתאם.

3. טיפול בתוכן כפול ופרמטרים של URL

אחת הבעיות הנפוצות באתרי מסחר היא ריבוי כתובות URL המובילות לאותו תוכן בדיוק. זה קורה בגלל פילטרים (צבע, גודל, מחיר) שיוצרים כתובות חדשות.

לדוגמה:

www.example.com/shoes?color=red

www.example.com/shoes?color=red&sort=price

מבחינת גוגל, אלו עמודים שונים. אם לא תגדירו לו אחרת, הוא יבזבז תקציב יקר על סריקת אלפי וריאציות של אותו עמוד. הפתרון הוא שימוש נכון בתגיות Canonical שמצביעות על הגרסה הראשית, או חסימת פרמטרים מסוימים דרך קובץ Robots.txt.

4. ניקוי עמודי זבל (Zombie Pages)

עמודי “זומבי” הם עמודים שקיימים באתר אך אין להם שום ערך לגולש או למנוע החיפוש. זה יכול לכלול עמודי תגיות ריקים, ארכיונים ישנים, עמודי תוצאות חיפוש פנימי ועוד. אם יש לכם 10,000 עמודים באתר אבל רק 2,000 מהם מביאים תנועה, אתם מדללים את תקציב הזחילה שלכם.

בצעו “גיזום תוכן” (Content Pruning): מחקו עמודים לא רלוונטיים (עם הפניית 410 או 404), או אחדו עמודים דלים לתוך מדריכים מקיפים. זהו חלק בלתי נפרד מאסטרטגיית כתיבת תוכן לאתרים בצורה איכותית – האיכות גוברת על הכמות.

5. תיקון שרשראות הפניה ושגיאות

שרשראות הפניה (Redirect Chains) הן מצב שבו עמוד A מפנה לעמוד B, שמפנה לעמוד C. כל “קפיצה” כזו מבזבזת משאבי זחילה ולעיתים גוגל פשוט יעצור באמצע. שאפו תמיד להפניה ישירה.

כמו כן, תקנו קישורים שבורים (שגיאות 404) בתוך האתר. כשגוגל נתקל בקישור שבור, הוא בזבז “קרדיט” זחילה על עמוד שלא קיים.

6. ניהול קבצי Sitemap

מפת האתר (XML Sitemap) היא הדרך שלכם להגיד לגוגל: “אלו העמודים החשובים ביותר שלי”. ודאו שמפת האתר נקייה משגיאות, אינה מכילה עמודים חסומים או עמודים עם הפניות, ומחולקת למספר קבצים אם האתר גדול מאוד (עד 50,000 כתובות לקובץ).

מתי להשתמש ב-Robots.txt?

קובץ Robots.txt הוא השומר בכניסה לאתר. השתמשו בו כדי לחסום בוטים של גוגל מאזורים שאין להם סיבה לסרוק, כמו אזורי אדמין, סקריפטים, עמודי עגלת קניות, או סביבות טסטינג. עם זאת, היזהרו לא לחסום משאבים (CSS/JS) הדרושים לרינדור הדף, שכן גוגל צריך לראות את האתר כפי שהגולש רואה אותו.